[新闻] AI新创公司Habana Labs挑战英伟达训练晶

楼主: zxcvxx (zxcvxx) 2019-06-26 11:13:12

AI新创公司Habana Labs挑战英伟达训练芯片的解决方案

1.原文连结:https://bit.ly/2XzNtsU

2.原文内容:

![]()

AI新创公司Habana Labs推出首款用于云端训练的人工智能处理器,称为Gaudi HL-2000。

其声称该AI处理器的训练系统的处理能力比起拥有相同数量的GPU系统还要高出4倍。

其实,Gaudi是Habana进军AI市场的第二次尝试成果。Habana在2018年第四季,向特定客

户发送其第一款AI芯片Goya推理卡。这款产品与英伟达的V100 GPU相比,在ResNet-50上

进行推理运算时,以HL-1000驱动的Goya能提供超过四倍的吞吐量,两倍的能源效率,以

及降低一半的延迟。

对Gaudi HL-2000而言,在ResNet-50模型中,每秒则可以处理1650张图片,功耗几乎是英

伟达Tesla V100的一半。因为根据测试,英伟达Tesla V100每秒约仅能处理600张图片,

功耗为300W。

Habana并没有提供太多关于芯片内部太多细节的资讯,只是声称它是基于第二代Tensor处

理核心(Tensor Processing Core, TPC)。此外,Gaudi处理器支持用于训练的典型浮点

格式,例如:FP32和bfloat16,以及一些整数格式。封装内内存则是采用32GB HBM2的

形式。

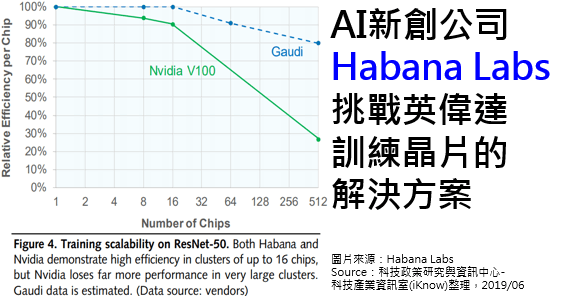

Gaudi最大的潜在优势可能是它能够大规模传送性能,这对于建构更大、更复杂的神经网

路一直是一个挑战。对于大多数训练设定来说,一旦超出8或16个加速器,也就是说,一

旦你离开服务器,性能就会趋于平缓。但是Gaudi却不是如此。同样的ResNet-50训练可以

扩展至数百台HL-2000处理器,性能接近线性成长模式。与V100相比,Habana技术在650处

理器级别中,在吞吐量方面实现了3.8倍以上的优势。

从产业趋势来看,训练AI模型每年需要以指数级成长的模式获得更高运算能力,如此才能

够满足数据中心和云端运算的迫切需求,进而大幅提高生产力和可延展性。现在凭借著

Gaudi的创新架构,Habana可提供产业界最高的性能,同时整合基于标准的以太网连接实

现无限扩展的可能。

总之,从评估系统到生产部署,这都是一条漫长的道路。如果Habana所宣称的技术能够按

照其承诺提供给产业界,AI市场的竞争模样将变得不太一样。毕竟,英伟达在AI硬件市场

,已经证明自己是一个能够采取快速反应市场的公司。如果Habana想要在AI芯片市场获得

更大的注目,就必须在激烈竞争的市场当中,证明自己的难耐。否则,昙花一现的新创公

司实在太多了,唯有真正展现范例,才是Habana能够成为AI芯片大厂的第一步。

3.心得/评论:

这家AI新创公司宣称其Gaudi HL-2000的性能优于英伟达的V100,虽然其芯片似乎拥有许

多潜在的优势,但该公司在生产部署上仍是一条漫漫长路。

1.原文连结:https://bit.ly/2XzNtsU

2.原文内容:

AI新创公司Habana Labs推出首款用于云端训练的人工智能处理器,称为Gaudi HL-2000。

其声称该AI处理器的训练系统的处理能力比起拥有相同数量的GPU系统还要高出4倍。

其实,Gaudi是Habana进军AI市场的第二次尝试成果。Habana在2018年第四季,向特定客

户发送其第一款AI芯片Goya推理卡。这款产品与英伟达的V100 GPU相比,在ResNet-50上

进行推理运算时,以HL-1000驱动的Goya能提供超过四倍的吞吐量,两倍的能源效率,以

及降低一半的延迟。

对Gaudi HL-2000而言,在ResNet-50模型中,每秒则可以处理1650张图片,功耗几乎是英

伟达Tesla V100的一半。因为根据测试,英伟达Tesla V100每秒约仅能处理600张图片,

功耗为300W。

Habana并没有提供太多关于芯片内部太多细节的资讯,只是声称它是基于第二代Tensor处

理核心(Tensor Processing Core, TPC)。此外,Gaudi处理器支持用于训练的典型浮点

格式,例如:FP32和bfloat16,以及一些整数格式。封装内内存则是采用32GB HBM2的

形式。

Gaudi最大的潜在优势可能是它能够大规模传送性能,这对于建构更大、更复杂的神经网

路一直是一个挑战。对于大多数训练设定来说,一旦超出8或16个加速器,也就是说,一

旦你离开服务器,性能就会趋于平缓。但是Gaudi却不是如此。同样的ResNet-50训练可以

扩展至数百台HL-2000处理器,性能接近线性成长模式。与V100相比,Habana技术在650处

理器级别中,在吞吐量方面实现了3.8倍以上的优势。

从产业趋势来看,训练AI模型每年需要以指数级成长的模式获得更高运算能力,如此才能

够满足数据中心和云端运算的迫切需求,进而大幅提高生产力和可延展性。现在凭借著

Gaudi的创新架构,Habana可提供产业界最高的性能,同时整合基于标准的以太网连接实

现无限扩展的可能。

总之,从评估系统到生产部署,这都是一条漫长的道路。如果Habana所宣称的技术能够按

照其承诺提供给产业界,AI市场的竞争模样将变得不太一样。毕竟,英伟达在AI硬件市场

,已经证明自己是一个能够采取快速反应市场的公司。如果Habana想要在AI芯片市场获得

更大的注目,就必须在激烈竞争的市场当中,证明自己的难耐。否则,昙花一现的新创公

司实在太多了,唯有真正展现范例,才是Habana能够成为AI芯片大厂的第一步。

3.心得/评论:

这家AI新创公司宣称其Gaudi HL-2000的性能优于英伟达的V100,虽然其芯片似乎拥有许

多潜在的优势,但该公司在生产部署上仍是一条漫漫长路。

继续阅读

[新闻] 玉晶光决配息3.5元,Q2获利向上Twinkling[标的] 3481 群创mayingnine[标的] 1232大统益是在涨什么东西?pshuang[新闻] 金融战开打?美媒:浦发银行或因违禁被拒sunbysea[新闻] 〈财报〉美光Q3财报打败预期 重启向华为 kaiming7955[闲聊]2019/06/26 盘中闲聊justforsing[新闻] 硅晶圆订单缩、现货价崩 半导体产业下半kaube[公告] Arjuju99 moomoo91426 Chrkamp gyman7788noldorelf[公告] danie10424 hillgill Baumgartner水桶 noldorelf[公告] a11780922 STAV72 gemini2010水桶noldorelf